ELK架构实现TB级日志监控系统的关键技术解析

随着企业业务规模的不断扩大,日志数据量呈现爆炸式增长,构建能够支撑TB级数据处理与存储的日志监控系统已成为现代IT运维的刚需。ELK(Elasticsearch、Logstash、Kibana)技术栈凭借其强大的数据处理能力、灵活的扩展性以及出色的可视化功能,成为搭建大规模日志监控系统的首选方案。

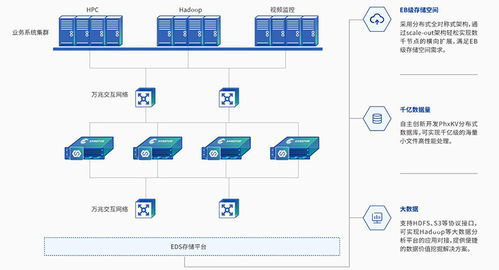

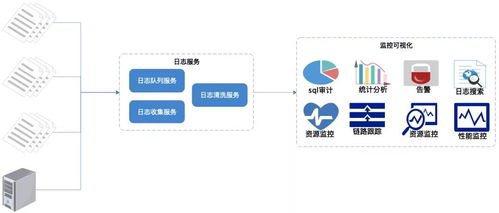

一、核心架构设计与组件分工

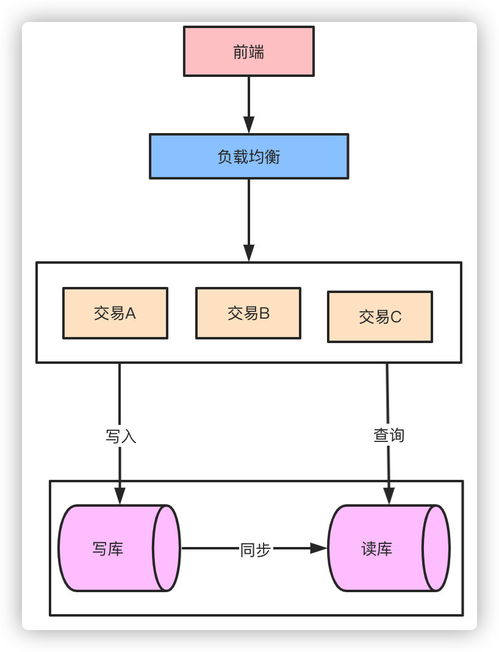

- 日志采集层:采用Filebeat或Logstash作为轻量级日志采集代理,部署在各个业务服务器上,实现实时日志收集与初步过滤。对于高吞吐量场景,可引入消息队列(如Kafka)作为缓冲层,提升系统抗压能力。

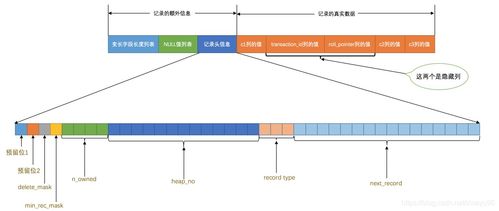

- 数据处理层:Logstash作为核心处理引擎,通过丰富的插件生态(grok、mutate、geoip等)对日志进行解析、清洗、格式转换和富化处理,将非结构化日志转化为结构化JSON文档。

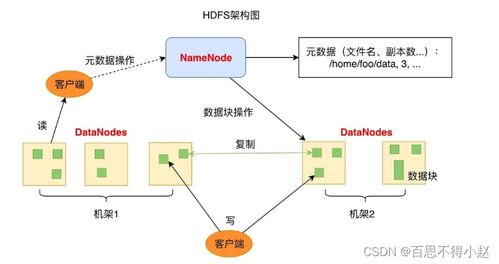

- 存储检索层:Elasticsearch分布式集群承担数据存储与检索的核心职责。通过合理设置分片策略、索引生命周期管理(ILM)和冷热数据分层存储,实现TB级数据的高效存储与毫秒级查询响应。

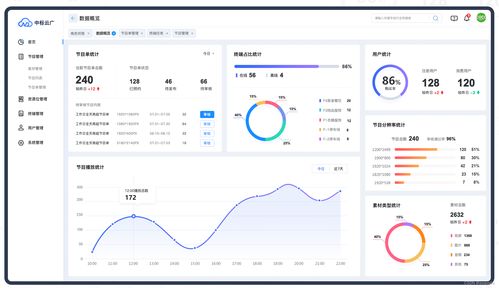

- 可视化展示层:Kibana提供直观的数据看板,支持实时监控仪表盘、异常告警配置、日志关联分析等功能,帮助运维团队快速定位问题。

二、TB级数据支撑的关键技术实践

- 集群优化配置

- 节点角色分离:将主节点、数据节点、协调节点、预处理节点分离部署,提高集群稳定性

- 分片策略优化:根据数据增长趋势设置合理的主分片数量(建议单分片不超过50GB)

- JVM堆内存配置:控制在物理内存的50%以内,通常不超过32GB

- 索引生命周期管理

- 热阶段:保留最近3天高频访问数据,采用SSD存储

- 温阶段:保留30天内数据,可适当降低副本数

- 冷阶段:归档历史数据,采用大容量机械硬盘存储

- 删除阶段:根据合规要求自动清理过期数据

- 查询性能优化

- 使用索引模式过滤查询范围

- 合理运用聚合查询的size参数

- 对常用查询字段建立倒排索引优化

- 启用查询缓存与请求缓存

- 高可用保障机制

- 跨机房集群部署实现容灾

- 设置最小主节点数防止脑裂

- 定期快照备份至对象存储

- 监控集群健康状态并设置自动告警

三、运维监控与最佳实践

- 建立完整的监控体系:通过Elastic Stack自身监控功能或集成Prometheus,对集群节点状态、索引性能、查询延迟等关键指标进行持续监控。

- 容量规划与扩容:建立数据增长预测模型,提前规划集群扩容方案,采用滚动升级方式实现业务无感知扩容。

- 安全加固:启用X-Pack安全模块,配置TLS加密传输、基于角色的访问控制(RBAC)、审计日志等功能。

- 成本优化:通过数据压缩、合理设置副本数、使用可搜索快照等方式降低存储成本。

四、典型应用场景

- 实时业务监控:追踪API响应时间、错误率、用户行为路径等关键业务指标

- 安全事件分析:通过日志关联分析发现异常访问模式和安全威胁

- 故障快速定位:通过分布式链路追踪快速定位系统瓶颈

- 合规审计:满足等保、GDPR等法规对日志存储期限和审计的要求

基于ELK构建TB级日志监控系统需要综合考虑架构设计、性能优化、运维管理等多个维度。通过合理的集群规划、索引策略和监控机制,ELK技术栈完全能够支撑起企业级大规模日志处理需求,为业务稳定运行和智能运维提供坚实的数据基础。随着Elasticsearch 8.x版本的发布,向量搜索、机器学习等新功能的加入,将进一步拓展日志监控系统的能力边界。

如若转载,请注明出处:http://www.jngwv.com/product/13.html

更新时间:2026-05-22 20:36:08